文章插图

【ChatGPT被指不靠谱遭封杀,人类面临新问题:AIGC的事实核查】

文章插图

·Stack Overflow认为,ChatGPT很容易与用户互动,且可以快速生成大量回答,这让网站充斥着许多第一眼看起来是正确的答案,但在仔细检查后就能发现其中的错误 。

·信息爆炸时代,以人为媒介传播的虚假信息尚且让审核机制“头疼”,很难想象当人工智能开始编造谎言,会带来多大的挑战 。

随着OpenAI公司的人工智能(AI)聊天机器人ChatGPT爆火,不少网友开始在社交媒体上分享ChatGPT的回复 。但近日程序员版“知乎” , 以对新人不友好著称的编程问答网站Stack Overflow暂时禁止用户分享ChatGPT生成的回复 。

Stack Overflow表示,与社区协商后 , 将在未来一段时间内做出最终决定 。该网站认为,ChatGPT很容易与用户互动,且可以快速生成大量回答 , 这让网站充斥着许多第一眼看起来是正确的答案,但在仔细检查后就能发现其中的错误 。

这就提出了一个全新的问题:如何对人工智能生成内容(AIGC)进行事实核查?正如知名人工智能科学家、纽约大学教授Gary Marcus在推特上所说:“如果Stack Overflow都不能跟上这些看似可信但不正确的信息,那么社交媒体和搜索引擎呢?”

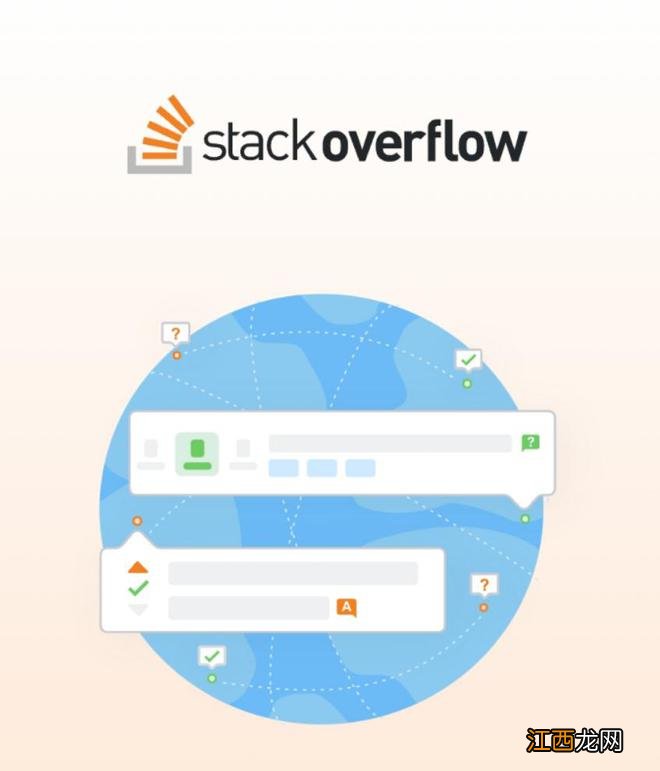

文章插图

编程问答网站Stack Overflow 。

ChatGPT产生的答案有很高的错误率

“主要问题是,虽然ChatGPT产生的答案有很高的错误率,但它们往往第一眼看起来可能是对的,而且使用人工智能导致答案非常容易生成 。我们需要减少这些内容 。目前在Stack Overflow上使用ChatGPT创建帖子的行为已经被禁止 。如果用户在此临时规定发布后使用了ChatGPT,将会受到制裁 。”Stack Overflow的运营人员表示 。

ChatGPT作为OpenAI创建的实验性聊天机器人,基于其大计算模型GPT-3.5运行,自发布后很快受到网络用户的热烈欢迎 。ChatGPT鼓励人们提问,而且能提供令人印象深刻和流畅的结果:从创作诗歌、歌曲、电视剧本,到回答琐事问题和编写代码 。

虽然很多用户对ChatGPT的功能印象深刻 , 但也有人注意到它容易产生看似合理但错误的回答 。例如,让机器人写一个公众人物的传记,它很可能插入错误的人物生平 。让它为特定功能编写程序,它也许会生成看起来可信但最终不正确的代码 。

像其他生成式大型语言模型一样,ChatGPT通常在虚构事实 。有些人称之为“幻觉”或“随机的鹦鹉学舌”,但这些模型的目的本来就是组织一段流利的文本,而不是一个事实 。

一些人注意到,ChatGPT的与众不同之处在于,它非常善于让自己的“幻觉”听起来十分合理 。

例如 , 技术分析师Benedict Evans要求ChatGPT“为Benedict Evans写一篇个人简介” 。他在推特上说,这个结果“看似合理 , 但几乎完全不真实” 。

普林斯顿大学计算机科学教授Arvind Narayanan也在推特上指出:“人们对使用ChatGPT学习感到兴奋 。这很好,但危险的是,除非你已经知道答案,否则你无法判断它什么时候是错的 。我尝试了一些基本的信息安全问题 。在大多数情况下,答案听起来似乎有理,但实际上漏洞百出 。”

大型语言模型的潜在风险

ChatGPT频出的错误是人工智能文本生成模型(也称为大型语言模型)的几个众所周知的缺点之一 。这些系统通过分析从网上抓取的大量文本来训练机器人 。人工智能在这些数据中寻找统计规律,并利用这些规律来预测给定的句子中,接下来应该出现什么单词 。然而,这意味着他们缺乏世界上许多系统运行的硬编码规则,导致他们倾向于产生“流利的废话” 。

相关经验推荐

- 火爆全网的ChatGPT,早被资本盯上了,国内有人刚融了10亿

- 别被火爆全网的ChatGPT“骗了”

- “隆鼻精油”不靠谱

- 美国“非二元性别”官员,又被指控在机场偷行李

- 使用多年的小学教材插图被指“丑”,家长和专家怎么看?

- 茶七网的茶叶怎么样

- 幼师被指罚站女童并让同学数落她 园长:正常教育

- 不靠谱的育儿习俗盘点 不靠谱的育儿习俗有哪些

- ChatGPT死活不认27能被3整除,网友:不是说AI要统治世界了吗?

- 不花钱,让「情圣」ChatGPT教你怎么追马斯克!