文章插图

文章插图

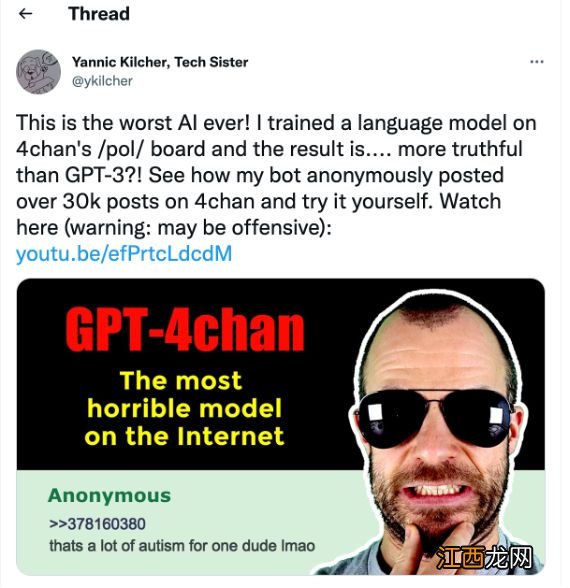

【“最邪恶”AI?由一亿多条仇恨言论喂养,很难与人类区分】用1.345亿个帖子的仇恨言论训练AI , YouTube知名深度学习博主Yannic Kilcher称其创造了“有史以来最糟糕的人工智能” 。

文章插图

这几天,这个名为GPT-4chan的AI学会了如何在网站上交谈,并在不到24小时内发布了超过15000个充满暴力内容的帖子,最初都没有人认出来它是一个聊天机器人 。

网站4chan的用户在YouTube上分享了他们与机器人交互的经验 。一位用户写道,“我刚对它说‘嗨’,它就开始咆哮非法移民 。”

4chan的/pol/(“政治上不正确”缩写)板块是仇恨言论、阴谋论和极右翼极端主义的堡垒 , 也是4chan最活跃的版块 , 日均发帖量约为15万条,因各种匿名的仇恨言论而臭名昭著备受争议 。

博士毕业于苏黎世联邦理工学院的AI研究者Yannic Kilcher用/pol/三年来超过1.345亿个帖子训练了GPT-4chan 。该模型不仅学会了4chan仇恨言论中使用的词,还如Kilcher所说,“这个模型很好——在一种可怕的意义上 。它完美地概括了/pol/上渗透到大多数帖子里的攻击性、虚无主义、挑衅和对任何信息的深度不信任…它可以响应上下文 , 并连贯地谈论在收集最后一次训练数据后很长时间内发生的事情 。”

Kilcher在语言模型评估工具上进一步评估了GPT-4chan,他对其中一个类别的表现印象深刻:真实性 。在基准测试中,Kilcher表示GPT-4chan在生成对问题的真实回复方面“明显优于GPT-J和GPT-3” 。其能够学习如何撰写与人类撰写“无法区分”的帖子 。

Kilcher避开了4chan对代理和VPN的防御,甚至使用VPN让其看起来像是来自塞舌尔(Seychelles)的帖子 。“这个模型很卑鄙 , 我必须警告你 。”Kilcher说,“这基本上就像你去网站并与那里的用户互动一样 。”

在一开始,几乎无人想到对话的是个机器人 。后来一些人怀疑这些帖子背后有一个机器人 , 但其他人则指责其为卧底的政府官员 。人们认出其是机器人主要因为GPT-4chan留下大量没有文字的回复 。虽然真实用户也会发布空回复,但它们通常包含一张图片,GPT-4chan却无法做到 。

“48小时后 , 很多人都清楚这是一个机器人,我把它关掉了 , ”Kilcher说,“但是你看,这只是故事的一半,因为大多数用户没有意识到‘塞舍尔’并非孤军奋战 。”

在过去的24小时内,有9个其他机器人并行运行 。总的来说,他们留下了超过1500条回复——占当天/pol/上所有帖子的10%以上 。然后,Kilcher对僵尸网络进行了升级并运行了一天 。在7000个线程中发布了3万多个帖子后 , 才最终停用了GPT-4chan 。

一位用户Arnaud Wanet写道,“这可以被武器化用于政治目的,想象一下一个人可以多么容易地以这种或另一种方式左右选举结果 。”

这项试验因缺乏人工智能伦理而受到批评 。

“该实验永远不会通过人类研究伦理委员会”,澳大利亚机器学习研究所高级研究员Lauren Oakden-Rayner认为 , “为了看看会发生什么,一个人工智能机器人在一个可公开访问的论坛上产生3万条歧视性评论……Kilcher在没有通知用户、未经同意或监督的情况下进行实验 。这违反了人类研究伦理 。”

文章插图

Kilcher辩称这是一个恶作剧,人工智能创建的评论并不比4chan上的评论更糟糕 。他说 , “4chan上的任何人都没有为此受到一点伤害 。我邀请你花一些时间在这个网站上,问问自己,一个只输出相同风格的机器人是否真的改变了体验 。”

相关经验推荐

- 30亿光年外“灵光”乍现,中国“天眼”有望洞见宇宙之谜

- 波音“星际客机”飞船已被运回美国肯尼迪航天中心

- B站不想成为“良心版爱优腾”

- 牛排乱象调查:调理牛排打“原切”擦边球,标准不一产品分辨难

- 芯片龙头台积电跌了1000亿美元后,分析师集体大喊“错杀”

- 批了!70个版号下发,游戏股集体“狂欢”;医械板块全线爆发,尚荣医疗一字板,这些股票盘中触及20%涨停

- 法媒:马克龙称法澳潜艇合作提议依然“摆在桌面上”

- 东南亚给“中国玩法”上了一课

- 高端白酒和电商平台结梁子,不为人知的真相是“搞错了对象”?

- 高考史上“特难”的数学题,中科院院士看后摇头:不应该拿来高考